Dit is het vierde artikel in een serie over wet- en regelgeving. Ik kijk hiernaar vanuit een economische en theologische blik.

AI (Artificial Intelligence) staat in het rijtje van klassieke apocalyptische gevaren, tussen de virussen en komeetinslagen die de mensheid zouden kunnen ontroeien. AI is zelfs een urgentere bedreiging voor de mensheid dan klimaatverandering, zegt Geoffrey Hint, een van de pioniers van AI, omdat we niet precies weten wat we eraan moeten doen.

De EU heeft ondertussen wel wat gedaan: er ligt een nieuwe wet, de AI Act. De ambitie is hoog. Deze nieuwe wet zou AI veilig moeten maken, en een standaard voor wereldwijde regelgeving moeten zetten. Maar waar ziet de EU nou precies de gevaren van AI in, en welke middelen zetten ze in ter verdediging?

Heel concreet worden twee praktijken verboden: realtime gezichtsherkenning en social scoring. Ofwel, de EU wil geen politiestaat faciliteren – een nobel streven! (Al staat er wel een achterdeurtje open door middel van samenwerking met niet-EU landen.) De andere gevaren van AI doet de AI Act af met een systeem gebaseerd op risicoinschattingen die door de ontwerpers van de AI-systemen zelf gemaakt wordt. Daarnaast moet een zogenaamd hoog-risicosysteem goedgekeurd worden door onafhankelijke Notified Bodies. Bovendien gelden allerlei transparantie-eisen. Hier gaan social media platforms, en AI platforms zoals ChatGPT, zeker door geraakt worden; het zal vooral veel administratieve rompslomp veroorzaken.

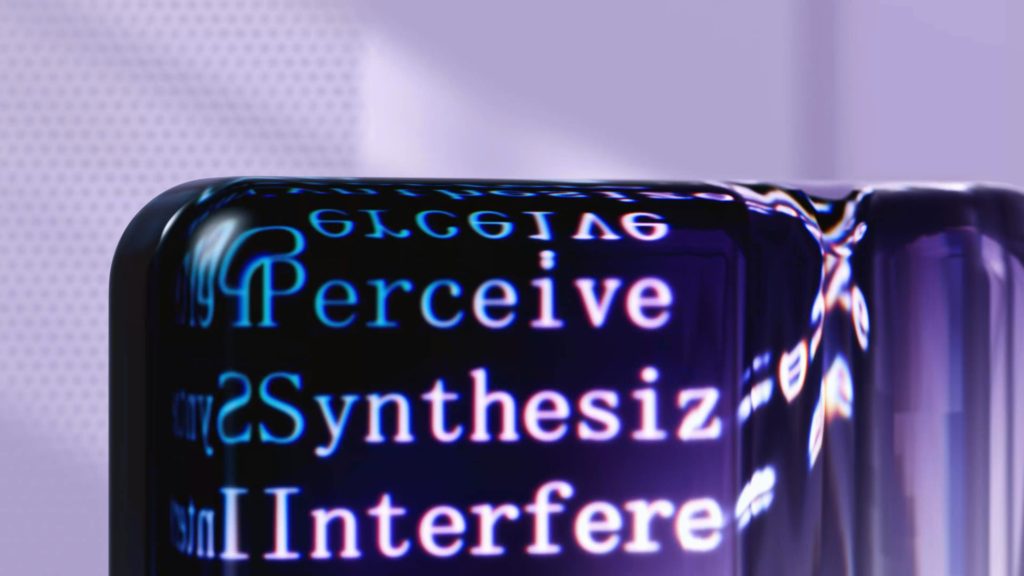

Een papieren tijger lijkt aan de andere kant een soft middel tegen killer robots en andere science fiction scenarios die iedereen vreest. Het risico is hoog, maar het wordt niet precies duidelijk waar het uit bestaat. De AI Act laat dit bewust in het midden, het is volledig aande ontwerpers van computersystemen om te beoordelen. Maar waar het risico dan ook precies uit bestaat, het moet in de computer zitten. De AI Act zit in een science fiction frame: de computer is een mens. In dit frame wordt de computer een entiteit die zelfstandig kan denken en kan handelen. De menselijkheid – of schijnmenselijkheid – van ChatGPT heeft de boel op scherp gezet: let op, computers worden nu echt slim, eerst versloegen ze de mens met schaken, en nu leren ze praten.

Dit lijkt een bedreiging, maar slimmere computers zijn juist handig, al geloof ik niet dat ze ooit even slim zullen worden als een mens. Nee, het echte gevaar is het omgekeerde: een beeld van de mens als computer. Een mensbeeld van een kille machine die regeltjes opvolgt zonder zich bewust te zijn van zichzelf en zijn omgeving. Waarin moraliteit slechts het resultaat is van een moeilijke rekensom.

Dit beeld van de mens als computer kwam op met de komst van computertechnologie in de jaren 1960. Objectief gezien leek een computer op dezelfde manier een probleem op te kunnen lossen als een mens, zoals naar voren gebracht door Herbert Simon. Tegenstanders van dit mensbeeld, onder andere John Searle, benadrukken de subjectieve kwaliteiten van het menszijn. Een computer kan niks begrijpen. Een mens, daarentegen heeft een hoog niveau van bewustzijn dat fundamenteel is voor ons zijn. Dit wordt ontkend door de zuiver objectieve benadering maar je kan het eenvoudig ook bij jezelf waarnemen.

De gevolgen van het mensbeeld als computer zien we overal om ons heen. Belangrijke beslissingen worden genomen door organisaties waarvan de medewerkers slechts regeltjes opvolgen, zonder dat er ruimte is om echt mens te zijn. Fancy technologie is geen vereiste om het mis te laten gaan. Natuurlijk, AI profiling is eng, maar etnische profilering kan met technologisch simpele middelen plaatsvinden, zoals we hebben gezien bij het toeslagenschandaal. En zo zijn er tal van simpele checklists of zelfs vage ideeën in de hoofden van mensen, die bepalen of iemand een huis krijgt, of een baan. Zonder dat we er erg in hebben kunnen deze processen oneerlijk of biased zijn.

De AI Act heeft een blinde vlek, en dat is de mens. De AI Act verwijst naar de EU Charter of Fundamental Rights, die gaan over de rechten van de mens, maar die vertellen niet wat ons tot mens maakt. Dit is in mijn ogen een hoog niveau van bewustzijn en de capaciteit om moreel te handelen. Het echte gevaar zit niet in de computer, maar in onszelf. Het gevaar is dat we onze menselijkheid vergeten en onze verantwoordelijkheid afschuiven, onder andere op AI. We moeten als mens zelf de regie pakken, en meer ruimte creëren voor moraliteit in besluitvorming. We moeten technologie inzetten om bias in besluitvorming weg te nemen en juist de samenleving menselijker te maken.

Guido Jacobs (guidojacobs[a]hotmail.com) is theoloog en econometrist en zal in een aantal artikelen zijn licht laten schijnen op de maatschappelijke gevolgen van regelgeving